作者:

吕倩

北京时间 11 月 11 日,人工智能初创公司月之暗面 Kimi CEO 杨植麟等人在社交平台 Reddit 上解答网友提问,回应关于模型训练成本等问题。

Kimi 近半年时间持续投入开源模型的研发与更新。11 月 6 日发布了最新版本的开源思考模型 Kimi K2 Thinking。彼时有消息称,Kimi K2 Thinking 的训练成本为 460 万美元,低于 DeepSeek V3 模型的 560 万美元和 OpenAI GPT-3 的数十亿美元。

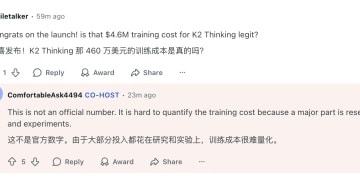

针对该数据,杨植麟在此次对话中回应称:(460 万美元) 不是官方数字,由于大部分投入都花在研究与实验上,因此训练成本很难量化。

网友也提出 Kimi K2 Thinking 推理长度过长、榜单成绩与实际体验不符等质疑,杨植麟表示现阶段该模型优先考虑绝对性能,token 效率会在后续得到改善,榜单高分与实测的脱节问题也会在模型通用能力得到补齐后被逐渐消解。

当下,越来越多的中国开源大模型在国际市场中被调用。记者搜索 OpenRouter 模型调用榜单,最新一周内,排名前二十名的模型产品中,中国开源模型产品占五席,具体包括 MiniMax M2、DeepSeek V3、GLM4.6、DeepSeek V3.1、DeepSeek V3.2 Exp。Kimi 因 OpenRouter 平台接口问题,目前只能以 API 形式被使用。

持续的模型更新与庞大训练量需要算力资源支持,Kimi 团队表示所使用的芯片是携带 InfiniBand(一种面向高性能计算和 AI 训练的网络互连技术) 的 H800 GPU,性能虽然比不上美国的高端卡,数量也处于劣势,但每张卡都被用到了极致。

整体来看,月之暗面 Kimi 未来很长一段时间内仍将坚持开源策略,重点推进 Kimi K2 Thinking 模型的应用与优化。在优先文本模型前提下兼顾多模态模型推进,避开与 OpenAI 等头部厂商在 AI 浏览器等具体赛道的直接竞争,通过架构创新、开源策略与成本控制尝试建立差异化优势。

(第一财经)

文章转载自东方财富